Il 13 marzo 2024 è stato approvato dal Parlamento europeo il Regolamento Europeo sull’intelligenza artificiale (AI ACT).

L’AI Act è il primo tentativo globale di regolare in modo completo e specifico l’uso dell’IA in una vasta gamma di settori, garantendo al contempo la sicurezza dei cittadini europei e la promozione dell’innovazione tecnologica. Si prevede che questo regolamento abbia un impatto significativo su aziende, organizzazioni e istituzioni che sviluppano e utilizzano sistemi di intelligenza artificiale.

Il nuovo Regolamento si applicherà a tutti i soggetti pubblici e privati che producono strumenti con tecnologia di intelligenza artificiale rivolti al mercato europeo.

Il regolamento riguarda sia i fornitori che gli utilizzatori dei sistemi a intelligenza artificiale. Gli acquirenti dovranno assicurarsi che il prodotto comprato abbia già superato la procedura di valutazione e conformità prevista, che sia provvisto di un marchio di conformità europeo e che sia accompagnato dalla documentazione e dalle istruzioni richieste.

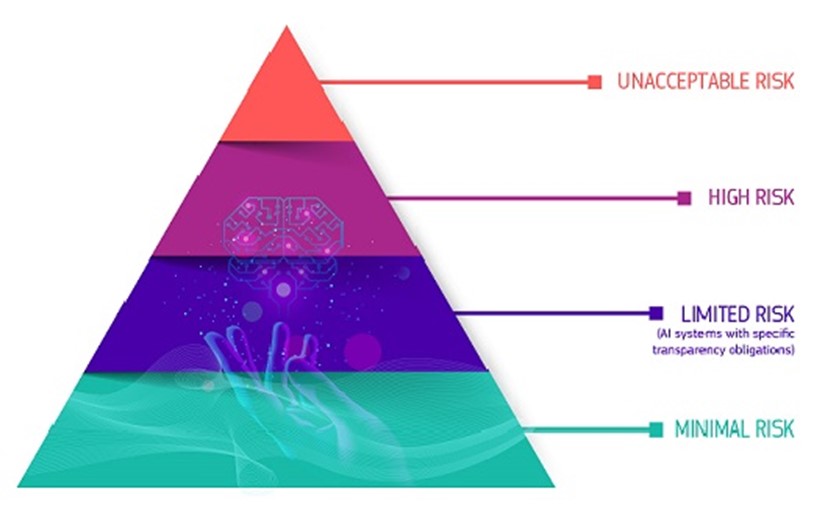

Il quadro normativo classifica le applicazioni di intelligenza artificiale in base al livello di rischio che presentano, definendo quattro categorie: rischio inaccettabile, alto, limitato e minimo. Ciò consente un approccio differenziato alla regolamentazione, garantendo che le restrizioni siano proporzionate al potenziale impatto negativo sull’individuo o sulla società.

LIVELLO DI RISCHIO INACCETTABILE: comprende i rischi che violano i valori europei. Vi rientrato a titolo esemplificativi gli strumenti di riconoscimento di emozioni da impiegare all’interno di scuole o di luoghi di lavoro, gli applicativi di social scoring (ovvero di selezione in base ai comportamenti), gli strumenti di identificazione biometrica con alcune eccezioni (es. per prevenire un reato).

LIVELLO DI RISCHIO ALTO: riguarda le applicazioni con impatto controverso e potenzialmente dannoso per la sicurezza e per i diritti delle persone. Si tratta di tecnologie non proibite, ma ammesse solo in presenza di specifici requisiti. Rientrano in questa categoria i sistemi di Intelligenza Artificiale generativa (come ad es. chat GPT). Per tali applicativi è richiesto l’adempimento di una serie di obblighi:

- un’approfondita valutazione preventiva dei rischi;

- la presentazione di tutta la documentazione necessaria per il rilascio dell’autorizzazione;

- obblighi informativi nei confronti degli utenti sullo scopo dell’applicazione;

- deve essere consentito l’intervento umano sull’algoritmo;

- obbligo di trasparenza sugli algoritmi.

I sistemi di Intelligenza Artificiale generativa devono inoltre rendere noto agli utenti che i prodotti generati sono prodotti da una macchina e non da esseri umani e devono spiegare come vengono allenati i modelli di linguaggio.

LIVELLO DI RISCHIO LIMITATO: riguarda i sistemi ai quali non sono connessi rischi considerevoli. Per tali applicativi sono previsti soltanto obblighi di trasparenza sulle modalità di funzionamento dell’algoritmo.

LIVELLO DI RISCHIO MINIMO: non è previsto nessun obbligo di legge.

ENTRATA IN VIGORE:

Il regolamento sull’Intelligenza Artificiale entrerà in vigore entro giugno 2024, salvo eventuali proroghe, con un periodo di transizione che consenta agli interessati di adeguarsi alle nuove regole e implementare le misure richieste.

- Entro sei mesi dall’entrata in vigore dovranno essere eliminati gradualmente i sistemi vietati dall’AI Act.

- Entro dodici mesi si applicheranno le norme di governance generali a tutte le aziende e le PA.

- Entro due anni dall’entrata in vigore il Regolamento sarà pienamente applicabile, comprese le norme per i sistemi ad alto rischio.

IL CONTROLLO:

Il controllo sull’applicazione del Regolamento è affidato agli Stati Membri che entro dodici mesi dall’entrata in vigore dovranno costituire apposite autorità locali con il compito di verificare il rispetto della normativa.

Anche la Commissione Europea avrà il potere di sorveglianza oltre che di applicazione delle sanzioni in caso di accertamento di violazione.

LE SANZIONI:

Il regolamento stabilisce le soglie delle sanzioni che saranno poi stabilite dagli Stati membri:

- fino a 35 milioni di euro o al 7% del fatturato totale annuo mondiale dell’esercizio precedente per le violazioni relative alle pratiche vietate o alla non conformità ai requisiti sui dati;

- fino a 15 milioni di euro o al 3% del fatturato totale annuo mondiale dell’esercizio precedente per la mancata osservanza di uno qualsiasi degli altri requisiti o obblighi del regolamento, compresa la violazione delle norme sui modelli di IA per uso generale;

- fino a 7,5 milioni di euro o all’1,5% del fatturato mondiale annuo totale dell’esercizio precedente per la fornitura di informazioni inesatte, incomplete o fuorvianti agli organismi notificati e alle autorità nazionali competenti in risposta a una richiesta (in tutti i casi a seconda di quale sia il valore più elevato).